Контент AI обвиняют в падении трафика. Настоящий виновник — контент-стратегия, которая никогда не выживает за пределами повышения свежести.

С тех пор, как мы смогли создавать масштабный контент с помощью искусственного интеллекта, X и LinkedIn разбросаны скриншотами графиков, обычно это тематические исследования или часть рекламных материалов.

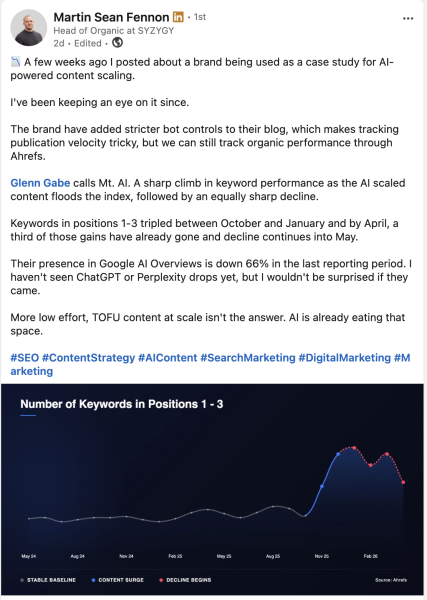

<п>SEO-специалист, которого я хорошо знаю, Мартин Шон Феннон, поделился примером текущего исследования бренда, масштабирования контента с помощью искусственного интеллекта и того, как контент получается (посредством стороннего измерения трафика).

Скриншот из LinkedIn, май 2026 г.

Проблема не всегда в том, что контент создан искусственным интеллектом; это всегда было хорошим показателем, на который можно возложить вину, поскольку существует гораздо больше факторов, влияющих на то, индексируется ли контент, не говоря уже о том, обслуживается ли он.

Настоящая проблема заключается в том, что масштабирование производства контента, независимо от метода, часто приводит к множеству проблем с контролем качества. ИИ — это просто новейший и самый простой «козёл отпущения» за фундаментальный сбой в конвейере контента, который включает в себя всё: от стратегии ключевых слов и выбора тем до редактирования, внутренних ссылок и распространения.

Однако такое распределение не является гарантией устойчивой производительности.

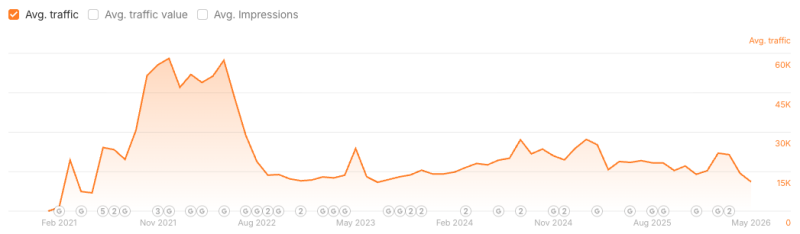

Запуск нового бренда в январе 2021 г., и первоначальный “boost” стихает через несколько месяцев. Не контент ИИ. (Изображение автора, май 2026 г.)

Первоначальный всплеск часто является результатом того, что системы Google эффективно обрабатывают новый или новый контент, а это означает, что он получает выгоду от «повышения новизны». Аналогичное повышение актуальности применяется, когда вы отправляете URL-адрес для индексации через консоль поиска Google.

Порог, с которым мы сейчас сталкиваемся, — это сохранение качества и актуальности в масштабе, как только первоначальная новизна перестанет действовать и “Mt. ИИ” Эффект спадает, оставляя позади основные проблемы с качеством контента.

Когда вы добавляете на свой веб-сайт много новых URL-адресов, вы просите Google увеличить ресурсы вашего сайта, и то, как Google распределяет эти ресурсы, хорошо документировано.

<п>Поскольку их воспринимаемый инвентарь теперь больше не соответствует вашему реальному инвентарю, Google должен выбрать, в какую часть новой группы URL-адресов инвестировать или стоит ли инвестировать в репрезентативную выборку новых URL-адресов (потенциально на основе шаблона URL-адресов, например, подпапки), а затем посмотреть, как пользователи реагируют на контент и взаимодействуют с ним.

Этот процесс определяет, оправдано ли, за вычетом первоначального повышения актуальности, URL-адрес (и контент) оставаться в индексе и обслуживаться.

<п>Эта концепция напрямую связана с краулинговым бюджетом и порогом качества Google. Если образцы URL-адресов работают плохо или не соответствуют определенной планке качества после того, как первоначальная новизна перестает действовать, остальная часть масштабированного контента часто с трудом набирает обороты.

Также стоит отметить, что пороговое значение не является статичным и меняется со временем по мере публикации контента более высокого качества, как отметил Адам Гент, и будет варьироваться в зависимости от темы, поскольку не все запросы заслуживают свежести.

Контент, созданный ИИ, приводящий к первоначальному всплеску трафика, за которым быстро следует плато или спад, делает пост в социальных сетях хорошим, но он также подчеркивает ключевое понимание того, что проблема не в самом ИИ, а в фундаментальном провале в стратегии контента и контроле качества в масштабе.

ИИ просто усиливает существующие слабости. Функция “увеличение свежести” получение новых URL-адресов маскирует эти основные проблемы, создавая временную иллюзию успеха.

Настоящим препятствием является порог качества Google, поскольку Google необходимо управлять ресурсами и стать более строгим в отношении того, что он сканирует (и как часто), и что сохраняется в индексе, готовом к обслуживанию.

Оценивая выборку новых URL-адресов, чтобы увидеть, действительно ли они привлекают пользователей и поддерживают ли они актуальность, можно избежать напрасной траты ресурсов. Если этот образец или более масштабный контент не будет соответствовать текущему порогу качества, ресурсы будут отозваны, и мы станем свидетелями большего количества “Mt. ИИ” сценарии.

Переход от масштаба производства к качественному обслуживанию в масштабе

Это важно, потому что полагаться исключительно на ИИ для увеличения объема — это тщеславный показатель, гарантирующий долгосрочную трату ресурсов.

<стр>Фокус должен сместиться с масштаба производства на поддержание качества в масштабе.

Бренды должны инвестировать в надежные редакционные процессы, человеческую стратегию и тщательный контроль качества (включая внутренние ссылки и распространение), чтобы гарантировать, что каждая часть контента, независимо от того, с помощью искусственного интеллекта или нет, постоянно превосходит развивающийся порог Google. Совсем недавно Google в Торонто описал это как нетоварный контент.

<п>Невыполнение этого требования означает постоянную погоню за мимолетным увеличением трафика вместо того, чтобы добиваться устойчивых, авторитетных органических результатов.